L'Europe vous protège

L'actuariel 29

Le 25 mai, le règlement européen sur la protection des données personnelles est entré en vigueur. Un bouleversement pour les entreprises et les institutions, qui doivent repenser leur gouvernance. Mais également un moyen politique pour l’Union européenne de prendre le leadership international sur la question.

Le règlement européen sur la protection des données personnelles (RGPD) peut-il s’appliquer aux États-Unis ? C’est l’une des questions posées à Mark Zuckerberg, le PDG de Facebook, lors de son audition devant le Congrès américain les 10 et 11 avril 2018. Empêtré dans le scandale Cambridge Analytica, il devait répondre de la fuite de données personnelles de 87 millions d’utilisateurs du réseau social. Un scandale qui a mis sur le devant de la scène les vertus du règlement européen.

À l’origine qualifié de protectionnisme européen, le RGPD est en effet pris en exemple. Tom Wheeler, l’ancien président de la Commission fédérale des communications (FCC), a d’ailleurs fait son éloge dans une tribune du New York Times le 1er avril dernier : « Pourquoi les Américains ne devraient-il pas être dotés d’outils significatifs pour protéger leur vie privée ? […] Le Nouveau Monde doit apprendre du Vieux. L’économie d’Internet a fait de nos données personnelles une marchandise. Le gouvernement des États-Unis doit rendre le contrôle de cette information à ses propriétaires. »

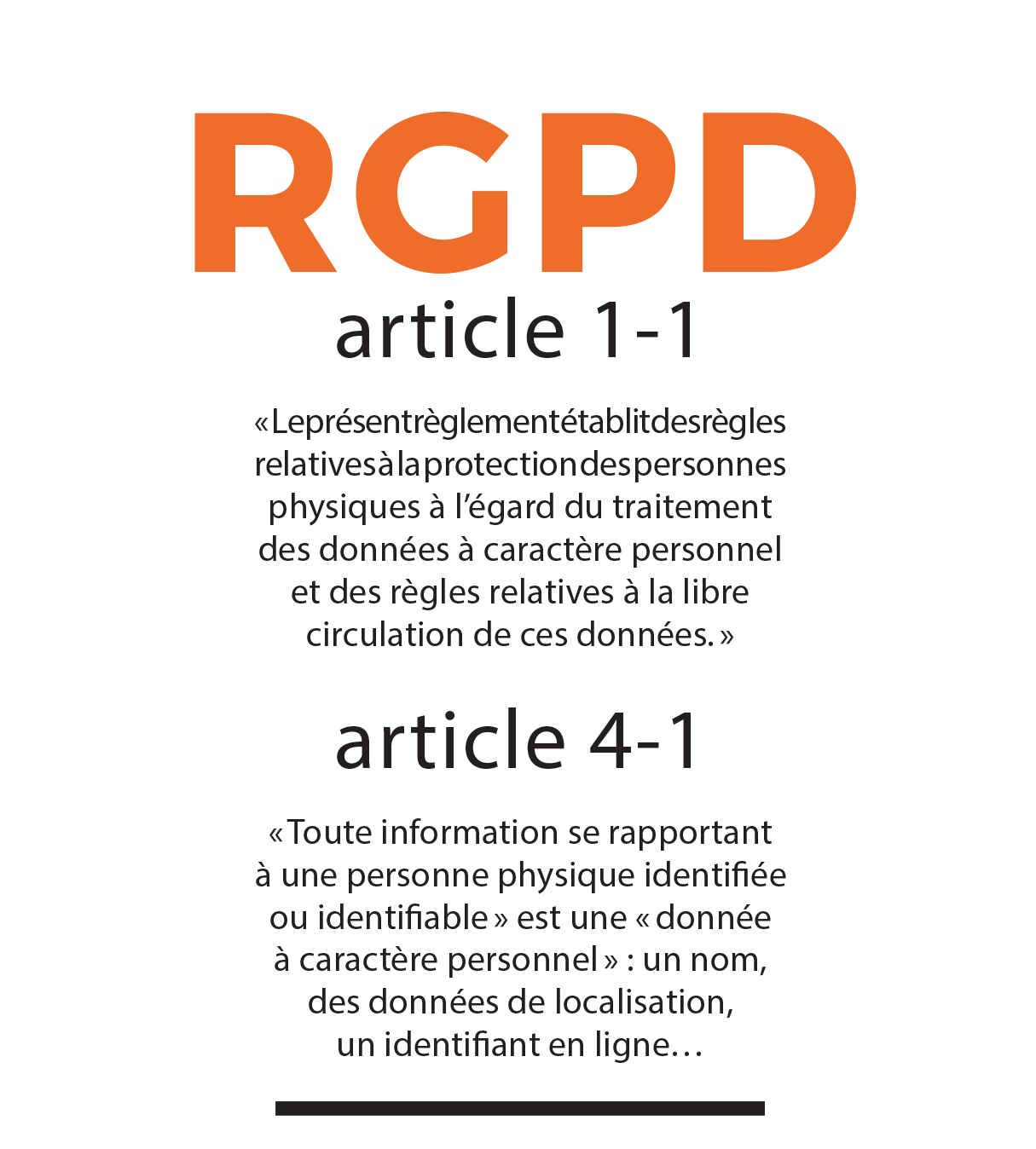

Voté en avril 2016, le RGPD accorde de nouveaux droits aux citoyens de l’Union européenne concernant leurs données personnelles et renforce les obligations et la responsabilité des acteurs. Et pas uniquement les droits des Européens : le RGPD ne se limite pas aux frontières de l’Union européenne, tous ceux qui traitent des données de ses citoyens doivent s’y conformer.

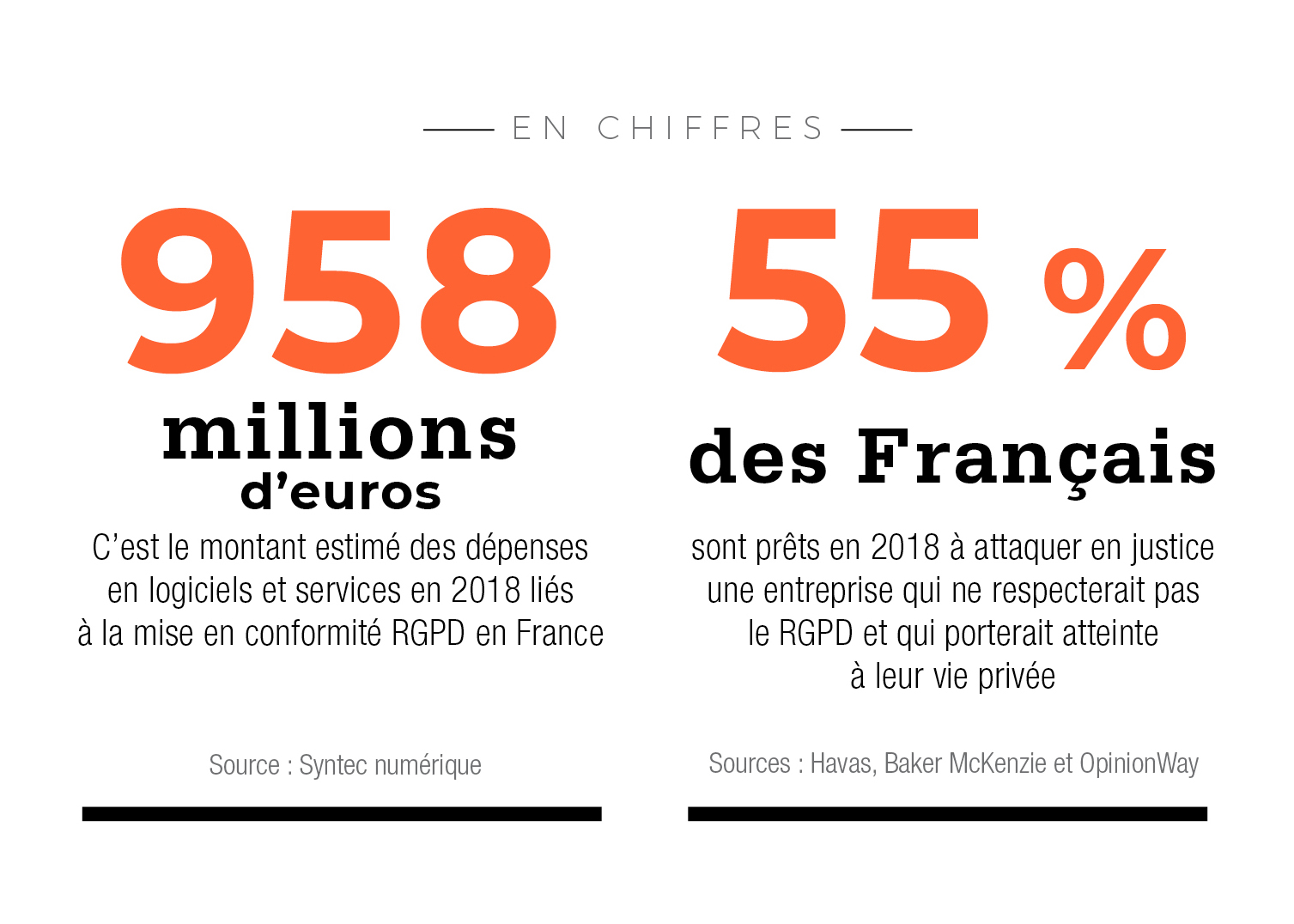

« C’est vraiment un important changement d’échelle, une très grande révolution en matière de gestion des données », estime Ariane Mole, avocate associée chez Bird & Bird et co-head de la pratique internationale en protection des données personnelles. Preuve de l’ampleur de l’enjeu pour l’Europe, le montant des sanctions : « Elles peuvent atteindre jusqu’à 4 % du chiffre d’affaires mondial annuel de l’entreprise. Ce qui fait passer la protection des données personnelles en deuxième position des risques les plus importants pour les entreprises, juste derrière ceux liés au droit à la concurrence », souligne Ariane Mole.

Le RGPD semble en effet être le fer de lance d’une croisade de l’Union européenne, au nom de la protection des données personnelles… Et une arme de plus face aux géants du numérique, aux pratiques dominatrices et fiscales décriées. Une stratégie globale semble d’ailleurs se dessiner. En avril, la Commission a édicté de nouvelles normes de transparence et d’équité pour les plateformes en ligne avec pour objectif de protéger les utilisateurs professionnels européens et notamment les petites entreprises. Même si elle n’a pas rassemblé l’unanimité nécessaire, son projet de « taxe numérique » de 3 % sur le chiffre d’affaires a fait trembler les Gafa (Google, Apple, Facebook, Amazon).

La question de l’éthique

Si le RGPD apporte plus de droits et de pouvoir aux citoyens européens, Jérôme Béranger, chercheur associé à l’Inserm et auteur du Code éthique algorithmique. L’éthique au chevet de la révolution numérique (ISTE Éditions), interroge sur sa portée et son efficacité : « Vous pouvez être RGPD compliant mais ne pas être éthique. Le RGPD ne parle pas d’algorithmes, des pratiques et des finalités qui évoluent. Or tout est lié, l’éthique des algorithmes et l’éthique des pratiques et des usages. Le RGPD ne garantit pas que vos données soient utilisées à bon escient. Vous pouvez faire des systèmes discriminatoires ou mettre en place un algorithme défaillant. » Au concept de privacy by design (protection de la vie privée dès la conception), le cofondateur d’Adel, société spécialisée dans l’évaluation éthique des données numériques, accole celui de responsability by design. « Tous les corps de métier directement ou indirectement liés doivent se retrouver autour de la table dès la conception d’un projet digital, d’intelligence artificielle ou de big data. Dans le domaine de la santé il faut même impliquer les associations de malades. Le système d’information doit répondre à la fois aux attentes du professionnel et aux exigences de l’usager », assure-t-il.

Les actuaires sont particulièrement concernés par le RGPD car la donnée est au cœur de leur métier. L’Institut des actuaires a choisi une ligne de conduite qui va au-delà des principes du règlement. En octobre 2017, il a publié une nouvelle norme professionnelle de catégorie 3 : la NPA5. Applicable depuis le 1er janvier 2018, elle encadre l’utilisation et la protection des données massives, des données personnelles et des données de santé à caractère personnel. « Il était très important que l’Institut définisse des règles déontologiques et des bonnes pratiques pour accompagner les actuaires dans l’exercice de leur métier tout en préservant les intérêts du public », souligne David Dubois, président de l’Institut des actuaires. D’autant que les actuaires sont de plus en plus concernés, en particulier lorsqu’ils sont confrontés à l’utilisation de données dans le cadre d’analyses comportementales, de segmentation et de profilage, ou de certains types de tarification.

La responsabilité de l’actuaire est renforcée par la réglementation, qu’il soit en responsabilité dans l’entreprise ou qu’il intervienne en tant que sous-traitant. « Les actuaires doivent instruire leurs clients et les aider à choisir la meilleure sécurisation des données, les conseiller sur la manière de les échanger, les mesures de sécurité à appliquer… Cela implique de discuter de manière plus intensive des instructions et des détails des traitements : a-t-on vraiment besoin des données personnelles ou bien des données anonymes ou pseudonymisées suffisent-elles ? Faut-il les transférer à l’étranger ou non ? », précise Ulrich Starigk, directeur juridique EMEA chez Milliman.

De la donnée à l’algorithme

À l’heure où l’intelligence artificielle est de plus en plus utilisée par les entreprises, notamment dans l’assurance, questionner la stratégie derrière l’algorithme, son cycle de développement, son pilotage, etc., s’avère primordial.

Le RGPD prescrit d’ailleurs que, pour être légal, un traitement automatisé de données personnelles doit pouvoir être justifié et donc correspondre à un fondement juridique légitime, par exemple « l’exécution d’un contrat entre la personne concernée et l’entreprise, ou si la personne concernée a donné son consentement explicite » ou encore reposer sur « l’intérêt légitime » de l’entreprise, qu’il faudra pouvoir expliciter. Dans tous les cas, les personnes doivent également pouvoir bénéficier de garanties : « Une information spécifique, le droit d’obtenir une intervention humaine, d’exprimer son point de vue, d’obtenir une explication en cas de décision automatisée, sur la logique sous-jacente qui a abouti à la décision. » « C’est un sujet important pour les entreprises : que dira-t-on et jusqu’où devra-t-on aller en cas de demande, jusqu’où va la transparence ? Le règlement indique cependant qu’il ne s’agit pas pour l’entreprise de révéler des informations qui relèveraient du secret des affaires, de la propriété intellectuelle ou de la propriété des bases de données », précise Ariane Mole.

Une menace pour l’innovation ?

De nombreux outils innovants sont impactés, selon Ulrich Starigk : « Avec le RGPD, toute personne a le droit de s’opposer à une décision qui est fondée exclusivement sur un traitement automatisé et qui produit des effets juridiques. Vous pouvez donc plus difficilement utiliser des calculs automatisés basés sur des données à caractère personnel afin de prévoir les conditions d’un contrat d’assurance. Et cela limite le champ d’action des sociétés qui, grâce au profilage des assurés, automatisent leurs calculs, sur la base desquels se greffent des propositions de contrats. C’est par exemple le cas des sociétés qui ont développé des systèmes de proposition automatique de contrats d’assurance santé, à condition de disposer de toutes les informations sur les médicaments achetés ou prescrits à la personne. Le challenge est le même pour de nombreuses jeunes start-up qui cassent les codes existants et proposent de nouveaux business models aux assureurs… »

Stephan Fangue, actuaire associé IA et directeur des données et approche client chez Generali, tempère : « En assurance, de nombreuses règles vont dans le sens du RGPD, telles la norme AERAS pour les contrats santé et le devoir d’oubli, l’interdiction d’utiliser le sexe en santé, etc. Le règlement vient à point nommé réaffirmer le cadre existant, à un moment où nous avons une importante puissance de calcul et les moyens de capter des données pour aspirer les profils numériques des personnes. » Le RGPD oblige les professionnels à se poser des questions sur l’avenir des pratiques, notamment concernant le développement de l’assurance à l’usage. Pour ne pas pénaliser l’innovation, il faudra trouver un équilibre entre les opportunités offertes par les technologies et la protection des consommateurs.

« Dans des programmes “pay as you drive”, qui modulent les primes en fonction de l’usage réel du véhicule assuré et de la qualité de conduite, nous sommes en contact très régulier, via les objets connectés, avec un assuré. Et là se pose la vraie question : qu’est-ce que, en tant qu’actuaire et technicien, j’ai le droit de faire ? Que faut-il légalement expliquer à mon client ? Mêmes questions avec les objets connectés de la maison, qui offrent de grandes potentialités pour l’assurance habitation… », illustre Stephan Fangue.

Une remise en question des bases existantes

Si, pour les offres innovantes, le RGPD pourrait avoir un impact fort, la collecte des données évolue peu pour les contrats classiques. « Quand vous venez assurer votre automobile, il est normal que l’on vous demande la date de votre permis de conduire, votre adresse, le modèle de votre voiture… Et cela ne changera pas, la réglementation indique bien que l’usage des données personnelles doit être en lien avec le service ou le produit proposé », ajoute Stephan Fangue. En revanche, les pratiques en matière de conservation des données, elles, vont être affectées. Certaines sociétés conseillent même à leurs clients d’effacer leurs données anciennes ! « Pour faire des calculs de provisions aujourd’hui, on regarde le trend d’évolution, de cadence de règlement sur une quinzaine ou une vingtaine d’années. On ne va pas supprimer ces données car vous ne pouvez identifier personne, ce sont des données agrégées, pour un exercice de souscription vous avez une année et un montant donné. Par contre, dans notre base clients, ou dans notre CRM, nous avons des informations sur des prospects ou des clients qui ont résilié la totalité de leurs contrats il y a un moment. Nous allons devoir les effacer parce qu’elles sont nominatives », détaille Stephan Fangue.

Le pouvoir de l’utilisateur final

Avec son caractère extraterritorial, le RGPD pourrait rebattre les cartes en matière de concurrence et remettre tout le monde à égalité notamment vis-à-vis des Gafa. Selon Paul-Olivier Gibert, PDG de Digital & Ethics, « des structures nativement européennes vont avoir plus de facilités pour respecter le RGPD que des entreprises extraeuropéennes ». Certaines assurtechs misent déjà sur leur agilité et le caractère novateur de leurs technologies pour faire du RGPD un atout. À l’instar de Spixii, qui a développé un chatbot pour Allianz, un agent digital automatisé qui communique avec les utilisateurs par message, lors de la phase de souscription puis lors de la gestion des sinistres. « En nous centrant sur l’utilisateur final, nous avons aligné nos technologies sur les exigences réglementaires dès notre création, en 2016. Le RGPD est une occasion pour nous de gagner de nouveaux clients car nous sommes en pointe sur le sujet », décrit son cofondateur et PDG, Renaud Million. « Pour devenir un véritable avantage concurrentiel, le RGPD doit en effet être un des éléments d’une stratégie globale du respect du client », renchérit Paul-Olivier Gibert. Les données personnelles sont évidemment un enjeu stratégique d’image vis-à-vis de la clientèle et des utilisateurs. « Le règlement prévoit la possibilité d’entamer des actions de groupe. Si, dans notre pays, la pratique n’est pas encore répandue, dans d’autres elles font d’énormes dégâts », indique Xavier Leclerc, PDG de Data Privacy Management System et président de l’Union des DPO (Data Protection Officers). L’obligation d’informer la Cnil sous 72 heures en cas de violation des données ainsi que les clients concernés aura d’importantes conséquences sur la perception de l’entreprise. Le retentissement de l’affaire Cambridge Analytica et la vague d’effacement de comptes Facebook le prouvent : les utilisateurs sont en demande de transparence et les conséquences en termes de réputation peuvent être désastreuses. Certaines entreprises l’ont bien compris, Microsoft applique le RGPD dans le monde entier et fait du règlement un standard dans sa politique de gestion des données personnelles.

Plus globalement, mieux protégés et dotés de droits nouveaux, les citoyens seront-ils finalement plus réticents à transmettre leurs données ? Dan Chelly, Senior Partner Risk Management chez Optimind n’y croit pas : « Même avant l’affaire Facebook, l’affaire Snowden avec la NSA avait fait prendre conscience au grand public de l’utilisation détournée des données qui sont présentes sur les réseaux. Il y a une vraie évolution sociétale en la matière, ces utilisations abusives ne sont plus acceptées aveuglément. Certes, les utilisateurs sont conscients des conséquences de la gratuité de ces services et, parallèlement, ils attendent de plus en plus d’offres personnalisées. Les consommateurs restent donc prêts à donner des informations les concernant pour avoir du sur-mesure, y compris sur des démarches marketing. »

point de vue

point de vue

Adrien BASDEVANT

Avocat associé Lysias Partners

Coauteur de L’Empire des données (éd. Don Quichotte)

Quelle est la portée du RGPD ?

Adrien BASDEVANT : Le RGPD est un formidable moment pour tous les citoyens de s’impliquer dans le débat sur la protection des données personnelles. Un sujet qui a longtemps été réservé à des spécialistes alors qu’il appartient à notre quotidien. La prochaine étape, c’est que le RGPD devienne un outil de soft power européen. Il va falloir le mettre en place et le promouvoir pour que de plus en plus d’acteurs, d’États se l’approprient, et que l’on élève le niveau de protection des données à l’international.

Pour reprendre le contrôle sur les données personnelles, certains évoquent le droit de propriété ou même la monétisation, qu’en pensez-vous ?

Adrien BASDEVANT : Concernant les données, il existe une approche américaine, qui est patrimonialiste, et une approche européenne, qui est personnaliste. Selon la première, les données relèvent de votre patrimoine, vous pouvez plus facilement les marchander, les monétiser. La seconde repose sur le modèle reconnu en 1976 par la Cour constitutionnelle allemande, qui consacre un droit d’autodétermination informationnel (droit d’accès, rectification). En exerçant ce droit, notamment auprès d’autorités indépendantes comme la Cnil ou par des voies judiciaires, vous pouvez faire valoir vos droits sur ces données et reprendre le contrôle sur la manière dont elles sont gérées. Pour moi, avoir un droit de propriété est une fausse bonne idée. Quand vous êtes propriétaire, cela suppose une exclusivité. Le problème est qu’une donnée prise isolément n’a pas de valeur. Une donnée n’a de la valeur que si elle circule.

« Il s’agit d’empêcher des algorithmes de prendre demain des décisions qui vont avoir un impact sur votre quotidien sans que vous puissiez le savoir, le vérifier ou le contester. »

Cela a-t-il d’autres conséquences ?

Adrien BASDEVANT : Le second problème est celui de la valorisation, chacun vend ses données mais il y a une asymétrie informationnelle. Les géants du numérique vont vous dire : « Votre code génétique, ça vaut 20 centimes. À prendre ou à laisser. » Vous allez vendre des choses à des prix complètement dérisoires, vous n’avez aucune marge de négociation, aucun pouvoir de valorisation. Pour autant, la question se pose de savoir s’il serait légitime d’être rétribué pour certaines utilisations de données, selon le modèle de l’open data avec le paiement de licences.

Certaines personnes considèrent au contraire que, si les données sont une émanation de notre personnalité (données sur vos préférences sexuelles ou votre orientation politique, etc.), elles sont rattachées à notre corps. Or nous n’avons pas le droit de vendre les émanations de notre personne.

La Chine est en train de développer un système de notation de ses citoyens basé sur leurs données personnelles. Quels sont selon vous les risques et les abus possibles liés aux données personnelles ?

Adrien BASDEVANT : La vraie question de demain, c’est la discrimination algorithmique. Le cas du credit social score chinois en est un bon exemple. Aujourd’hui les données personnelles sont évoquées, et tout le monde vous parle de vie privée. Mais il faut comprendre que la valeur sociale qui doit être protégée n’est pas uniquement la vie privée ; il s’agit d’empêcher des algorithmes de prendre demain des décisions qui vont avoir un impact sur votre quotidien sans que vous puissiez le savoir, le vérifier ou le contester. Par exemple, les entreprises sont capables de connaître votre historique de navigation sur Internet, votre géolocalisation, et peuvent prendre en compte des critères qui auparavant étaient inaccessibles. L’arrondissement de Paris dans lequel vous habitez, votre couleur de peau, votre sexe ou même le groupe de rock que vous écoutez sont-ils des critères acceptables ? À partir du moment où les prises de décision sont traitées par des algorithmes, il faut comprendre comment ils fonctionnent pour savoir s’ils n’intègrent pas de biais ou de discriminations.

RGPD

Quelques points chauds

Le principe de responsabilité nécessite des procédures et des politiques de protection des données personnelles qui révolutionnent l’organisation de l’entreprise et sa culture.

Définition et anonymisation

La définition des données personnelles selon le RGPD est très large : « Toute information se rapportant à une personne physique identifiée ou identifiable », soit des données de localisation, des identifiants en ligne… « Le règlement est lourd et les transpositions en droit français sont plus sévères que dans les autres pays. Et il y a encore beaucoup d’incertitudes. L’anonymisation n’est pas une solution miracle, c’est une nécessité dans certains cas. Il s’agit non seulement de soustraire le nom mais de ne pas pouvoir retrouver la personne. Or, dès lors que vous avez des données qui sont découpées finement et peu de catégories, ce n’est pas suffisant, il est toujours possible de l’identifier », souligne Michel Piermay, président de Fixage, membre du Syndicat des actuaires conseils et actuaires experts indépendants et du Haut-conseil de l’Institut des actuaires et actuaire agrégé IA.

Le rôle du DPO

La nomination d’un DPO témoigne de la conduite d’une politique de responsabilité. Cependant, au sein des entreprises, il peut rapidement être débordé par l’ampleur de la tâche. « Le DPO se retrouve avec un nombre incalculable de sollicitations : “Est-ce que je peux afficher tel élément sur un contrat ? Je lance une étude sur un marché cible dans le cadre de la DDA ou de MIFID, qu’ai-je le droit de faire sur cet échantillon dans ce cadre ?” », explique Dan Chelly, Senior Partner Risk Management chez Optimind.

La traçabilité

L’obligation de tenir un registre de traitement des données et de faire des analyses d’impact fait de la traçabilité des données une question centrale du RGPD. La sensibilisation des salariés est essentielle à la mise en conformité et les notions à maîtriser sont nombreuses : connaissance des procédures de collecte, de traitement, d’archivage et de destruction des données. « Par ailleurs, les personnes doivent explicitement autoriser l’accès à leurs données pour un usage précis défini à l’avance : même l’utilisation ultérieure pour de simples statistiques est interdite s’il n’y a pas cette autorisation explicite préalable. Une fois traitées, les données doivent être détruites ou sécurisées de manière à n’être accessibles par exemple qu’à un nombre restreint d’interlocuteurs : contrôleurs, autorités antiblanchiment, fisc… Les actuaires doivent concilier traçabilité et protection des données », estime Michel Piermay.

Le consentement au cœur du débat

La définition du consentement est revue par le RGPD. Il doit être informé, libre et spécifique, c’est-à-dire qu’il ne peut pas être lié à l’acceptation d’un contrat. « Les entreprises doivent également fournir une information sur le profiling avec le droit d’opposition au profiling. Cela s’applique particulièrement à l’analyse des risques ou au ciblage à des fins de marketing et implique de modifier les mentions d’information dans les contrats avec les assurés mais aussi dans tous les formulaires », précise Ariane Mole, avocate associée chez Bird & Bird et co-head de la pratique internationale en protection des données personnelles. Mais c’est surtout la question du retrait du consentement qui fait l’objet de discussions. « Le groupe des Cnil européennes a récemment sorti des guidelines sur l’information des personnes concernant la transparence, qui indiquent que le retrait de consentement devrait avoir des conséquences y compris sur les traitements réalisés après qu’il a pris effet. Je pense qu’il est légitime que les assureurs en discutent avec la Cnil car il n’y a pas de raison de considérer que, lorsque la personne retire son consentement, cela annihile tous les traitements précédents, ce serait abusif et pourrait encourager la fraude », explique l’avocate.

NPA5

Les règles d’or pour les actuaires

Avant même l’entrée en vigueur du RGPD, l’Institut des actuaires s’est saisi de la question des données personnelles. Il est le premier institut au niveau international à avoir élaboré une norme professionnelle pour encadrer non seulement l’utilisation mais aussi la protection des données massives, des données personnelles et des données de santé à caractère personnel. La norme est entrée en vigueur le 1er janvier 2018.

Privilégier l’anonymisation.

La norme incite les actuaires à préférer l’usage de données personnelles anonymisées ou, à défaut, à rendre impossible la réidentification des individus.

Une durée de conservation limitée.

Les données personnelles doivent être conservées pour une durée déterminée. Un allongement de celle-ci doit faire l’objet d’une démarche spécifique, avec l’accord explicite du DPO.

Maîtriser les outils.

Les possibilités offertes sont énormes, tant en termes logiciels que de bases de données, mais elles ne doivent pas faire oublier la responsabilité de l’actuaire. En utilisant ces outils, il devra documenter son contrôle, utiliser des méthodes alternatives et faire état de ses doutes.

Éviter la discrimination.

L’actuaire doit vérifier que des variables discriminantes au regard des réglementations ne sont pas utilisées. Il doit également s’assurer de ne pas réaliser de discrimination tarifaire de façon indirecte du fait de variables externes.